Tokyo, Jepang – Yu Takagi tidak bisa mempercayai matanya. Duduk sendirian di mejanya pada Sabtu sore di bulan September, dia menyaksikan dengan takjub saat kecerdasan buatan memecahkan kode aktivitas otak subjek untuk membuat gambar dari apa yang dia lihat di layar.

“Saya masih ingat ketika saya melihat gambar pertama (dihasilkan AI),” Takagi, seorang ahli saraf berusia 34 tahun dan asisten profesor di Universitas Osaka, mengatakan kepada Al Jazeera.

“Saya pergi ke kamar mandi dan melihat diri saya di cermin dan melihat wajah saya dan berpikir, ‘Oke, ini normal. Mungkin saya tidak akan menjadi gila’”.

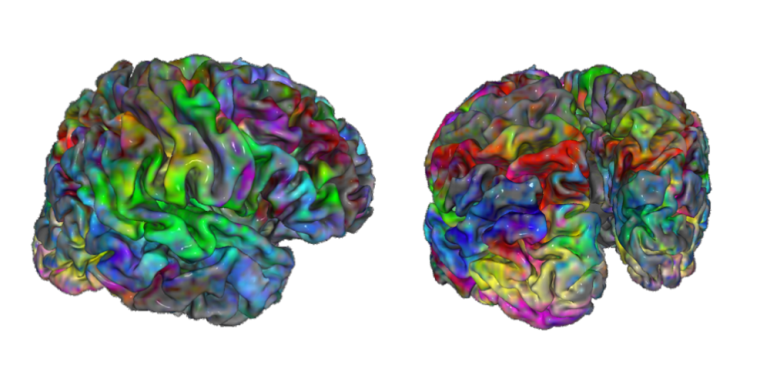

Takagi dan timnya menggunakan Stable Diffusion (SD), model AI pembelajaran mendalam yang dikembangkan di Jerman pada tahun 2022, untuk menganalisis pemindaian otak subjek yang terpapar hingga 10.000 gambar saat ditampilkan di mesin MRI.

Setelah Takagi dan rekan penelitiannya Shinji Nishimoto membuat model sederhana untuk “menerjemahkan” aktivitas otak ke dalam format yang dapat dibaca, Stable Diffusion mampu menghasilkan gambar dengan ketelitian tinggi yang sangat mirip dengan aslinya.

AI mampu melakukan ini meskipun tidak diperlihatkan gambar sebelumnya atau dilatih dengan cara apa pun untuk menghasilkan hasil.

“Kami benar-benar tidak mengharapkan hasil seperti ini,” kata Takagi.

Takagi menekankan bahwa terobosan tersebut tidak mewakili membaca pikiran pada saat ini — AI hanya dapat menghasilkan gambar yang telah dilihat seseorang.

“Ini bukan membaca pikiran,” kata Takagi. “Sayangnya, ada banyak kesalahpahaman dengan penelitian kami.”

“Kita tidak dapat memecahkan kode imajinasi atau mimpi; kami pikir ini terlalu optimis. Tapi tentu saja ada potensi di masa depan.”

Namun perkembangan tersebut menimbulkan kekhawatiran tentang bagaimana teknologi tersebut dapat digunakan di masa depan di tengah perdebatan yang lebih luas tentang risiko yang ditimbulkan oleh AI secara umum.

Dalam surat terbuka bulan lalu, para pemimpin teknologi termasuk pendiri Tesla Elon Musk dan pendiri Apple Steve Wozniak menyerukan jeda pada pengembangan AI karena “risiko besar bagi masyarakat dan kemanusiaan.”

Terlepas dari kegembiraannya, Takagi mengakui bahwa ketakutan seputar teknologi membaca pikiran bukan tanpa alasan, mengingat kemungkinan penyalahgunaan oleh mereka yang bermaksud jahat atau tanpa persetujuan.

“Bagi kami, masalah privasi adalah hal yang paling penting. Jika pemerintah atau institusi bisa membaca pikiran orang, itu adalah masalah yang sangat sensitif,” kata Takagi. “Harus ada diskusi di tingkat tinggi untuk memastikan ini tidak terjadi.”

Penelitian Takagi dan Nishimoto menghasilkan banyak gebrakan di komunitas teknologi, yang telah disetrum oleh kemajuan besar dalam AI, termasuk rilis ChatGPT, yang menghasilkan ucapan seperti manusia sebagai tanggapan atas permintaan pengguna.

Menurut Altmetric, sebuah perusahaan data, makalah mereka yang merinci temuan tersebut berada di 1 persen teratas untuk keterlibatan di antara lebih dari 23 juta keluaran penelitian yang dilacak hingga saat ini.

Studi ini juga telah diterima untuk Konferensi Computer Vision and Pattern Recognition (CVPR), ditetapkan untuk Juni 2023, rute umum untuk melegitimasi terobosan signifikan dalam ilmu saraf.

Tetap saja, Takagi dan Nishimoto berhati-hati agar tidak terbawa oleh temuan mereka.

Takagi berpendapat bahwa ada dua hambatan utama untuk membaca pikiran yang sebenarnya: teknologi pemindaian otak dan AI itu sendiri.

Meskipun ada kemajuan dalam antarmuka saraf—termasuk komputer otak elektroensefalografi (EEG), yang mendeteksi gelombang otak melalui elektroda yang dipasang ke kepala subjek, dan fMRI, yang mengukur aktivitas otak dengan melacak perubahan yang terkait dengan aliran darah—ilmuwan percaya bahwa kita mungkin masih beberapa dekade lagi dari mampu secara akurat dan andal memecahkan kode pengalaman visual yang dibayangkan.

Dalam penelitian Takagi dan Nishimoto, subjek harus duduk di pemindai fMRI hingga 40 jam, yang mahal dan memakan waktu.

Dalam sebuah makalah tahun 2021, para peneliti di Korea Advanced Institute of Science and Technology mencatat bahwa antarmuka saraf konvensional “tidak memiliki stabilitas perekaman kronis” karena sifat jaringan saraf yang lunak dan kompleks, yang bereaksi dengan cara yang tidak biasa saat dihubungkan dengan antarmuka sintetis. kontak.

Lebih lanjut, para peneliti menulis: “Teknik perekaman saat ini umumnya bergantung pada jalur listrik untuk mengirimkan sinyal, yang rentan terhadap gangguan listrik dari lingkungan. Karena gangguan listrik secara signifikan mengganggu sensitivitas, ini bukanlah kinerja yang mudah untuk mencapai sinyal halus. dari area target dengan sensitivitas tinggi.

Keterbatasan AI saat ini menghadirkan hambatan kedua, meskipun Takagi mengakui bahwa kemampuan ini semakin maju dari hari ke hari.

“Saya optimis dengan AI, tapi saya tidak optimis dengan teknologi otak,” kata Takagi. “Saya pikir itu adalah konsensus di antara ahli saraf.”

Kerangka Takagi dan Nishimoto dapat digunakan dengan perangkat pemindaian otak selain MRI, seperti EEG atau teknologi hiper-invasif seperti implan otak-komputer yang dikembangkan oleh Neuralink Elon Musk.

Meski begitu, Takagi yakin saat ini hanya ada sedikit aplikasi praktis untuk eksperimen AI-nya.

Pertama-tama, metode tersebut belum dapat ditransfer ke mata pelajaran baru. Karena bentuk otak bervariasi antar individu, Anda tidak bisa langsung menerapkan model yang dibuat untuk satu orang ke orang lain.

Tapi Takagi melihat masa depan di mana itu bisa digunakan untuk tujuan klinis, komunikasi atau bahkan hiburan.

“Sulit untuk memprediksi aplikasi klinis yang berhasil pada tahap ini karena ini masih sangat banyak penelitian eksplorasi,” kata Ricardo Silva, seorang profesor neurologi komputasi di University College London dan rekan peneliti di Alan Turing Institute. Jazeera.

“Ini mungkin tampak sebagai salah satu cara tambahan untuk mengembangkan penanda untuk deteksi Alzheimer dan penilaian kemajuan dengan menentukan dengan cara apa seseorang dapat mendeteksi kelainan yang terus-menerus dalam gambar tugas navigasi visual yang direkonstruksi dari aktivitas otak pasien.”

Silva berbagi keprihatinan tentang etika teknologi yang suatu saat dapat digunakan untuk pemikiran yang tulus.

“Masalah yang paling mendesak adalah sejauh mana pengumpul data harus dipaksa untuk sepenuhnya mengungkapkan penggunaan data yang dikumpulkan,” katanya.

“Login adalah satu hal untuk mengambil snapshot dari diri Anda yang lebih muda untuk, mungkin, penggunaan klinis di masa depan… Menggunakannya dalam tugas-tugas sekunder seperti pemasaran, atau lebih buruk lagi, digunakan dalam kasus hukum terhadap kepentingan seseorang.”

Tetap saja, Takagi dan rekannya tidak berniat memperlambat penelitian mereka. Mereka sudah merencanakan versi kedua dari proyek mereka, yang akan berfokus pada peningkatan teknologi dan penerapannya pada modalitas lain.

“Kami sekarang sedang mengembangkan teknik rekonstruksi (citra) yang jauh lebih baik,” kata Takagi. “Dan itu terjadi dengan kecepatan yang sangat cepat.”